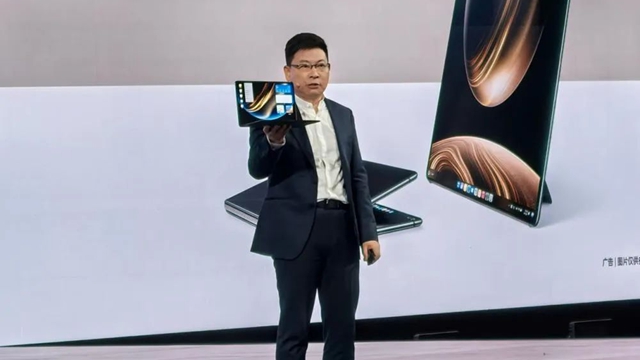

2025年5月22日,由世界超高清视频产业联盟(UWA联盟)主办的“2025超高清与人工智能产业创新沙龙”在第六届深圳国际人工智能展览会期间圆满举行。本次沙龙以“AI与超高清深度融合”为主题,汇聚了中央广播电视总台、中国移动咪咕公司、中国移动杭研、芒果TV、博冠、诺瓦星云、四开花园、魔珐科技、中南大学、OpenVideo、景秀子非等多家机构、院校的60余名行业内的重量级嘉宾,围绕产业趋势、产业机会、问题与挑战、核心技术等进行了深度交流,为未来超高清与AI融合发展擘画蓝图。

本次论坛由中央广播电视总台超高清视音频制播呈现国家重点实验室常务副主任、UWA联盟副秘书长梅剑平主持。

UWA联盟秘书长张文刚在开场致辞中指出:AI/AIGC与超高清结合对于提升内容生产效率、提升用户体验、开创产业创新、促进商业闭环已经展现巨大的机会。同时在应用中,业界也面临AI DEEP FAKE ,AIGC能力不足等多重挑战。联盟将持续推动创新技术标准和生态共建,推动AI与超高清结合,助力企业在新一轮产业竞争中占据先机。

UWA联盟产业研究总监王斌对本次沙龙的策划和研讨做了整体引导:UWA2030产业规划中,已识别出超高清与AI结合的63个典型细分应用场景,今年将会面向产业征集应用案例和论文,持续深化和扩展AI与超高清融合应用场景。通过本次研讨,将发掘超高清与AI 在采集、编辑、播控、传输、显示、终端、用户、应用的各个链条的机会,识别发展中的挑战,为联盟下一步的产业规划提出建议。

中央广播电视总台技术局正高级工程师范晓轩分享了“央视听”媒体大模型赋能智能制播体系,以及在内容生成、古籍还原、财经新闻自动播报等场景的探索。他认为,AI不仅能提升内容生成效率,更是构建智能制播新架构的基础。下一步,总台将以媒体资产活化为突破口,打造具备可控性与创新性的内容生态。

芒果TV资深专家谭嵩分享了“云制作平台推动超高清内容普及”。谭嵩聚焦芒果TV的云原生制作体系,强调通过设备兼容和流程并行,实现了剪辑工作站降本增效。他提到:“我们自研云平台不仅解决了硬件成本高的问题,还构建了三维音效、HDR实时回调等多维制播能力。”行业需聚焦终端还原标准,推进三维音频的普及与体验一致性 。

中国移动咪咕公司系统开发总监毕蕾分享了咪咕在世界杯、CBA等重大赛事中运用AI进行多视角编排、智能高光剪辑、自动解说的案例。她指出,AI推动体育直播从“转播”向“互动内容”演进,并提出:“未来将以AIGC模型为驱动,打造用户主导的个性化观赛体验”。

诺瓦星云中研院实验室主任林先萌提出“清晰、流畅、真实、互动、健康”五维显示模型,系统讲解了AI在动态超分、色度还原、自适应节能等终端显示中的落地。他特别指出:“现阶段AI算法仍面临分辨率固定化、实时处理瓶颈等问题,显示芯片能力与算法适配仍是行业短板”。

作为从业20年的资深内容人四开花园副总裁于路以“技术与表达”为题,呼吁AI应成为“协作工具”而非“主导创作者”。他指出:“创作的本质仍是人的情感与观点。AI若脱离表达逻辑,容易导致内容的趋同与乏味。”他建议行业应为创作者保留创意空间,避免“算法绑架创作”。

魔珐科技政企事业部总经理梁健分享了魔珐科技在三维数字人领域的创新成果,提出“企业专属AI员工”将成为未来趋势。通过标准化构建“可代表企业形象、具备高互动性、对接大模型”的数字人形象。梁健强调,虚拟人必须低成本、可规模化、具情感表达,才能真正成为企业内容生产、客服服务与品牌运营的核心支点。

博冠光电研发总监王旭耀介绍了AI与超高清在风电智能运维中的融合实践,提出通过“固定摄像+边缘AI”的方式实现风机叶片7×24小时高效巡检。该系统已落地多个风场,可识别十余类叶片缺陷,替代传统人工与无人机巡检,显著提升巡检效率与安全保障。他指出:“工业级AI视觉系统是未来绿色能源安全的守护者。”

中南大学教授鲁鸣鸣围绕“具身智能”展开演讲,强调AI从数据逻辑走向物理现实的必要性。他指出,未来AI不仅要“理解世界”,更要“介入世界”,需同时具备感知环境、推理规划、动作执行三大能力。他展示了基于“视觉+语言+行为控制”的机器人系统原型,并认为:“具身智能是AI迈向通用智能的关键跃迁路径。

OpenVideo研究员赵之源表示团队发布了首批超10万条高清视频片段数据集,涵盖200多个细分场景,全部基于合法开源协议。团队构建了涵盖爬虫、清洗、标注的全流程工具链,并通过社区协作持续提升标注多样性与准确性。未来将推进标签精细化、多模态拓展与工具链优化,帮助中小企业低门槛接入AIGC模型训练,为开源生态注入持续动力。

景秀子非总经理罗健分享了基于2D表情数据驱动3D模型骨骼系统的技术路径,能够显著提升数字人表情自然度,降低创作门槛。他展示了真实人脸映射3D角色的效果案例,指出当前AI仍在细节一致性方面面临挑战。他展望未来:“技术迭代将助力虚拟角色在元宇宙、VR等场景中实现情感级表达,成为虚拟内容产业的重要支点。”

中国移动杭研高级体验测试专家周叶林通过视频分享了“AIGC体验和测评探讨”,提出构建AIGC音视频内容评估的新标准,围绕匹配感知、交互感知与安全感知三个维度开展主观评测。他表示,当前生成内容仍存在逻辑跳跃、创意缺乏等问题,需推动评测体系与应用场景深度融合。他强调:“科学有效的评测机制将成为AIGC大规模应用的关键保障,是产业走向可信生成的基础设施。”

UWA联盟新技术总监罗峻兮回顾了联盟在AIGC应用、模型适配与中间件建设中的实践。他指出,当前AI技术正以“去中心化+开源协同”模式迅猛发展,但在数据依赖、协议兼容与芯片适配等方面仍存在重大瓶颈。联盟尝试搭建具备国产芯片适配能力的一站式工具链,并关注通信协议、信息安全与能耗结构等底层架构问题。他呼吁构建开放的AI中间层平台,实现技术普惠、产业开放与基础设施可控,为未来AI大规模普及打下核心底座。

本次沙龙集中呈现了超高清与人工智能融合创新的前沿图景,与会嘉宾就技术攻坚与生态共建达成三大共识:其一,AIGC技术正重构"制编播显"全产业链条,需加速算法优化与算力突破,重点攻克内容逻辑性、显示实时性等技术瓶颈;其二,产业协同创新成为关键路径,需通过标准化评测体系、开源数据生态及工具链共享,构建"技术研发-场景落地-商业转化"的闭环;其三,人机协同创作将定义内容产业新范式,既要发挥AI在素材处理、流程提效方面的优势,更需建立保障创作者主导权的机制。未来,UWA联盟将持续推进超高清与AIGC融合创新,并启动"超高清+AI"双驱创新计划,联合产学研力量共建开放生态,助力数字内容产业升级。