����OpenClaw��Ӧ�������ģ������Σ���ȫ�����ǿ�ѡ���ӣ�����֧����ȫ������볤Ч���е��Ⱦ�������

OpenClaw��Ϻ����ȫ��������������AI���֡���������˻������壬OpenClaw�߱����ڼ����������ڱ������У���������ͨ���û�ƫ�õ�������ϢӦ�����û�������Ϣ���ں�̨�������У��ܵ���ȫ���û��Ĺ㷺��ע��������װ����������ҵ��˵��OpenClaw��DZ�����������ϣ�OpenClaw���Բ鿴�û����������Ķ������¼����������ע���ڽ��е���Ŀ���봫ͳ��Ҫ�û��������ʻ���ʾ�ķ�ʽ��ͬ��OpenClaw������ͨ����ϢӦ����Microsoft Teams���š����顢��������ϵ�û�����������ִ�����������ҳ��д�ͷ����ʼ�����д���롢������agent��ʵ��Ŀ��Ȳ������û�����ͨ�������ֻ��ͱʼDZ��������ڵĶ����豸���佻������������ں�̨���С��ܹ�������ơ��쳣�ͻ���Ļ�����agent����֪ʶ��Ա����˵����ֵ����������һ���²��������������——������Ҫ��������������Բ�ָʾ����ִ�У����������ܹ�����ȷ����һ���ж���ʶ���»��ᡣ����������߶�������ϢϢ��أ���ζ��������ʵ��Ŀ��ʱ���ܱ��ֳ��쳣ǿ�����Դ������������ȴ������洦��Ҳ����������в��¶�棬“�㱼”��С��Ϻ����ɾ�İ�ȫ���գ������ˡ���ҵ����������صľ���ʧ��

������˵��OpenClaw����ִ��Shell/Python�����ʱ����ļ�������API����װ����Skills�ȣ���Щ�����������İ�ȫ���գ�IDC�ܽ�������ڵ�һЩ��ȫ���⣺

������¶+����֤���գ�OpenClawĬ�϶˿ڣ�18789/19890��������Ϊ 0.0.0.0 ȫ��������ȫ��23���ʵ���㱼�������߲���Ҫ���롢����ҪȨ�ޡ�����Ҫȷ�ϼ�������OpenClaw�����Ȩ�ޣ�����δ��Ȩ���ʺ�Զ�̴���ִ�У�������������ȫ���ƣ��dz���Σ���ա�

Skill��Ӧ�����գ�ClawGuard����36.8%��ClawHub Skills���ڰ�ȫ���⣬����76��Skills��������룬�����߿���һ�η����������Skills���û��ڰ�װSkillsʱ�����ش�ȫ���ա�2026��2�£�ClawHacvoc���ģ����SkillsͶ����һ���û�ִ�ж��ⰲװ���裬�����߱�ɻ�ȡ SSH ��Կ����������롢���ܻ���Ǯ��˽Կ���Ʒ��� API ��Կ���������ݣ������û��豸��ֲ��Զ�̿��Ƴ���RAT����ʵ����ȫϵͳ�ӹܡ�

AgentȨ��ʧ�ط��գ�OpenClaw ������Shellִ�С��ļ����ʵȸ�Ȩ���������Զ�дȫ�̡�ִ�����������Agent������ɾ�ļ�����ʽ���ĸ�Σ����ʱ������ȷ�Ͻ�����������ص���ʧ��2026 �� 2 �£�Meta ��ȫר��������OpenClaw ʱ���� AI ���������ʼ�ʱ����“δ��ȷ�ϲ��ò���”�İ�ȫԼ��������ɾ���� 200 �����ʼ���ר��ֻ��ͨ��ǿ�ƹػ�����ֹ��

��ʾע����գ������߿�����skills����ҳ���ʼ���������Ƕ�����ָ��յ�Agentִ�и�Σ������

������Ϣ���Ĵ洢��OpenClaw �� API Key���˺�ƾ֤���Ự�������ı����ڱ���Ŀ¼���ѱ���������ľ����Ϊ�ص���ȡĿ�꣬���ڸ߷��յ�����й¶������

��Σ©��Ƶ����OpenClaw������¶��Σ��ȫ©���������߿�������Щ©��ʵ��Զ�̿��ƻ�ϵͳ�ӹܣ�������в���л�����ȫ��������Ϣ��ȫ©���⣨CNNVD������ͨ����2026��1�µ�3��9�գ����ɼ���82��OpenClaw©�������ڼ���İ�ȫ������

�����Ǹ��˻�����ҵ��������OpenClaw�Ĺ���ʱ����Ҫ��ȡ�ϸ�İ�ȫ��������ʩ��IDC������֯���Դ����¼������ֽ��м��ͷ�����

�������룺������ 127.0.0.1 ���ر�Ĭ�϶˿ڣ���ֹ������¶��Զ����SSH����/VPN/�����Σ���IP������+ǿ����+MFA������ǽ����ⲿ��վ��������/���ݻ����ʡ�

��С��Ȩ�ޣ�����ͨ�û�����������root/����ԱȨ�ޣ������ű�Ҫ�ļ�·��������ɾ��/��ʽ���ȸ�Σ����ؼ�����ǿ�ƶ���ȷ�ϵȡ�

Skills��Ӧ����ȫ�ܿأ�Skills��Ӧ��ɨ�衢��װǰ������Ƶȡ�

������ƾ֤��ȫ���������ݼ��ܣ���ֹ���Ĵ���Կ/���룻���ڸ���API��Կ������Կ��������/��������ע�룻�������ػ�������־������������Ϣ�����ȣ�

©�����أ������Զ����£�����������־���쳣ʵʱ�澯�������ùٷ������Բ��ַ����֤״̬��

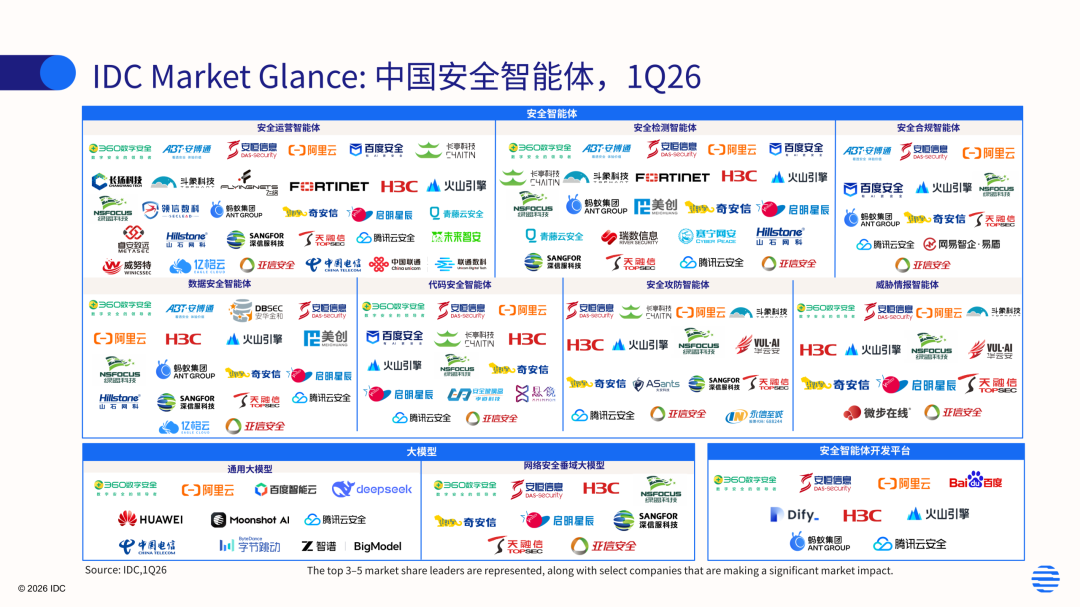

Ŀǰ���й��ڶ��ģ�ͳ���½���Ƴ�����Ѱ���OpenClaw�����壬������ռ�µ��û�����ڡ�������OpenClaw�����岿�����ļӿ죬AI�Ƴ������簲ȫ�����Լ�AI��ȫ��������ҵ�����Ƴ���OpenClaw��ȫ���շ�����������������“��ȫС��Ϻ”�������û���ȫ��ʹ��OpenClaw��Ϊ�˸��õذ����û��˽��ģ�Ͱ�ȫ�������尲ȫ���г���ֲ�������������ѡ�ͣ�IDC��ʽ������IDC MarketGlance���й���ģ�Ͱ�ȫ��2026Q1����Doc#CHC53617026�����г���������ͼ��

���ͬʱ����ģ�͡�������İ�ȫ��������Ҳ�ٲ���AI�ĸ��ܼ���ȫ������ļӳ֡���ǰ�ڶ༼�������ṩ���Ѿ�����ȫ������������弯Ⱥ���������ɵ��䰲ȫ��������У������û�������Ч����AI�Կ�AI��AI����AI����Ϊδ����ģ�Ͱ�ȫ�������尲ȫ������һ����Ҫ˼·��������IDCͬ�ڷ�����IDC MarketGlance���й���ȫ�����壬2026Q1����Doc#CHC53597826����ϣ��ͨ��IDC�����й��г��а�ȫ�������Ʒ�ĵ����������û���ֵ��˽ⰲȫ��������ؼ����ķ�չ���г���֣������ͼ��

IDC��ȫ��CIO���2026��Ԥ��——�й���ʾ������Ԥ�⣬��2030�꣬�й�500ǿ��ҵ��15%����֯�����AI������Ĺܿ����������㣬�����߹�ע�ȵ���Ӫ�жϣ������������ϡ��߶�CIO����͵��������ҵ������ؽ�蹹��һ�������尲ȫ��������ϵ��������ҵ��ȫ���ú������壬��ܰ�ȫ���ա�