以ChatGPT、LLama为代表的大模型技术正持续推动社会变革,引发新一轮人工智能热潮。当前流行的大模型具有数千亿甚至上万亿参数规模,单个计算节点无法满足训练需求,训练过程耗时巨大,需要通过分布式训练框架充分整合可调动的算力资源进行分布式并行加速。目前国产芯片厂家百花齐放,智算中心可选的算力资源类型多样,但由于目前Megatron等主流的分布式训练框架仅支持同构算力集群,导致无论是不同厂商的智算芯片之间,亦或是同一厂商不同代际芯片之间都无法形成“合力”,极大地限制了智算中心对现有算力资源使用的充分性和调度的灵活性,因此亟需面向异构算力混合训练需求进行技术研究。

当前,智算异构混合并行训练存在一系列技术挑战。由于不同智算芯片存在计算架构、缓存资源、互联方式等诸多差异,各厂商硬件接口互不兼容,导致多种智算芯片难以协同工作。同时,由于AI计算框架与各厂商基础软件栈深度绑定,因此仅能针对特定硬件生成单一训练策略,无法实现跨厂商、跨代际芯片训练所需的多策略生成及任务分发等能力需要。

应对上述技术挑战,中国移动联合产业从计算策略拆解和任务分发协同两个层面对智算异构混合并行训练技术机制开展研究:

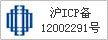

在计算策略拆解方面,面向混合训练技术需求,构建“非均匀计算任务切分(Inhomogeneous Task Distribution,ITD)”算法。针对不同厂家芯片的计算接口和特性建立特征表达,构建多厂商智算芯片隔离机制,在感知神经网络模型结构的基础上,基于批次数量,序列长度,隐藏层大小等参数评估神经网络各层计算量,为多厂商智算集群依据算力大小和计算特性分配最匹配的计算任务,实现多厂商智算集群上的非均匀计算任务切分。同时,引入ITD算法性能预测机制,通过实时或离线的性能模拟仿真生成最优切分策略。

图1.非均匀计算任务切分算法说明

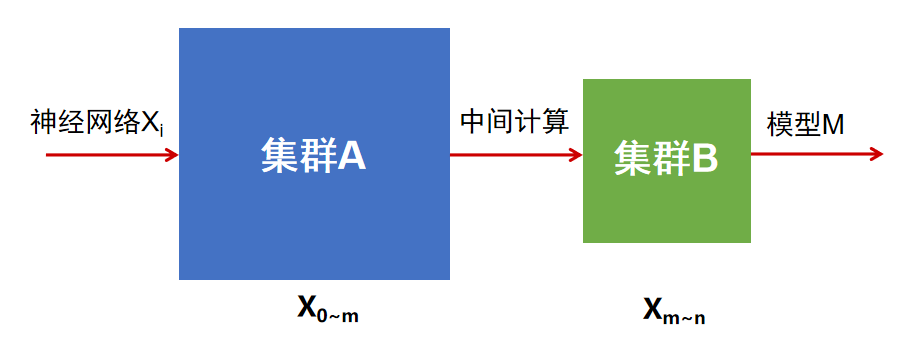

在任务分发协同方面,构建智算混合异构系统环境下任务分发模型,设计异构节点的任务逻辑分组方法,进而构建训练任务的分发映射、加载调度、故障释放等机制,目标实现分布式智能算力集群间任务的高效管控;同时打造训练任务间的数据协同机制,解决不同厂商智算芯片在通信接口、协议、拓扑等方面的差异,设计多厂商互识的标准约束,并按约束规实现重映射,实现异构集群上的任务一体协同。

图2.面向异构混合算力的分布式并行训练技术架构

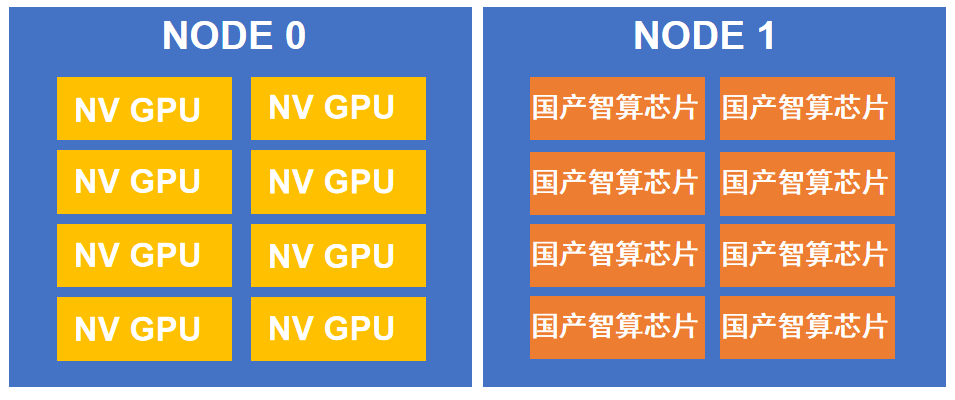

上述混合并行训练机制参数维度多样、感知机制及捷联关系复杂,涉及从顶层框架到底层基础软件的系列改造。为加速技术验证,中国移动研究团队聚焦模型类型,限定模型并行策略、约束硬件类型并减少节点间异构通信环节,在NVIDIA GPU和国产智算芯片所组成的混合算力资源池中,开展对LLaMA2模型混合训练的技术试验。通过预设定大模型策略生成模型特征参数,可实现针对不同异构算力的任务拆解及分发协同,模型训练过程可正常收敛,且混合训练吞吐量能达到上限的97.5%,初步证明技术方案的整体可行性,且能够优化混合算力集群的训练性能指标。

图3.混合训练试验环境示意图(以两节点为例)

后续研究团队将持续深入探索智算异构混合并行训练机制,逐步拓展验证方案及模型场景,攻破大模型混合训练系列挑战,加速技术能力落地,助力万亿级参数大模型发展。