目前业界模型性能通常与训练期间投入的资源绑定,除了头部厂商大肆投入资源训练模型外,许多小型企业和个人开发者实际上并不具备足够的资源,为了解决这一问题,许多团队试图寻找降本增效替代方案。

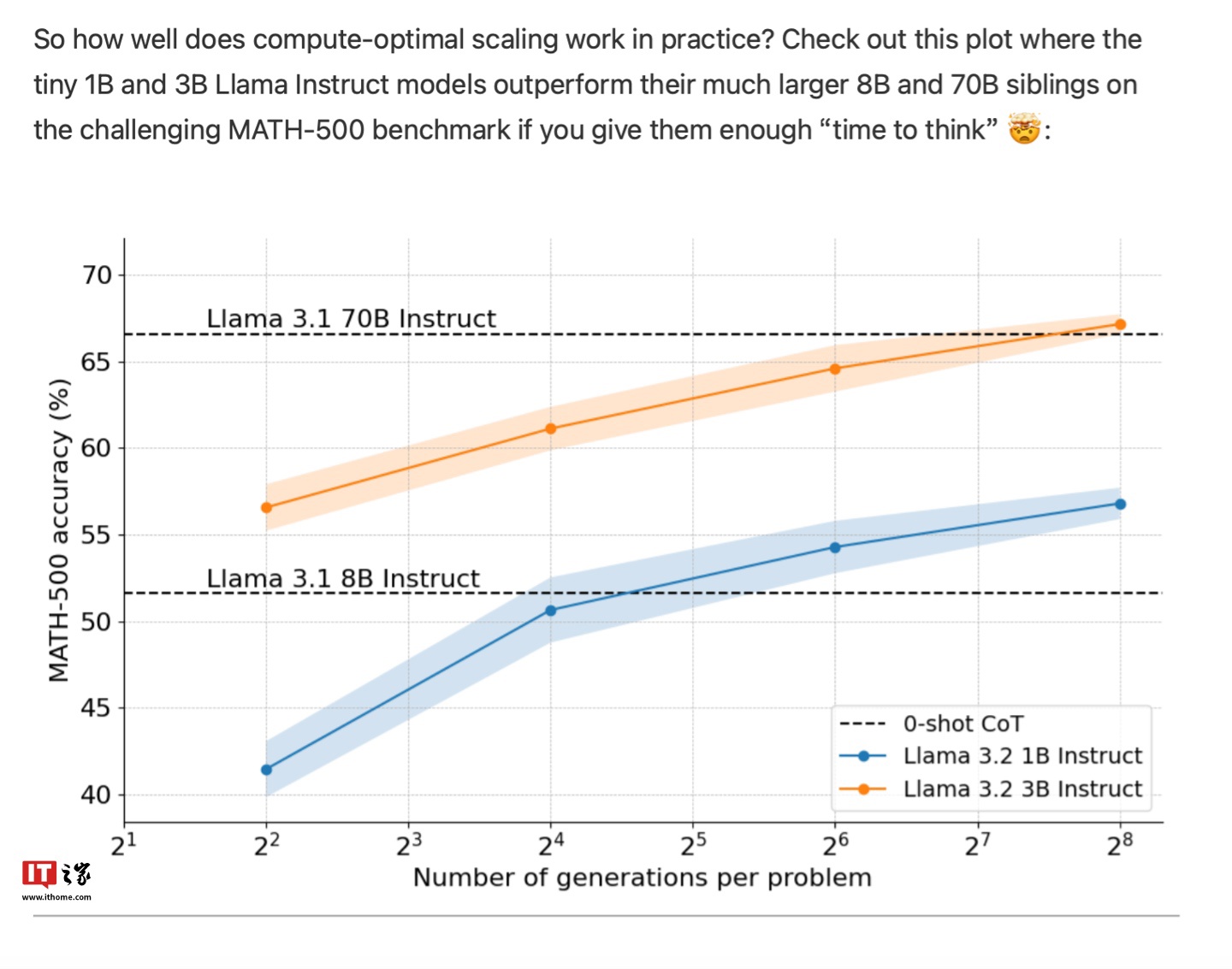

Hugging Face 于本月中旬公布一项报告,提出一种“扩展测试时计算(IT之家注:Test-Time Compute Scaling)”方法,也就是用时间来弥补模型体量,给予“低成本小模型”充足时间,让相关模型能够对复杂问题生成大量结果,再利用验证器对这些结果进行测试及修正,反复输出能够比拟“高成本大模型”的结果。

Hugging Face 团队表示,他们使用这种方法利用 10 亿参数的 Llama 模型进行数学基准测试,据称在某些情境下超越了参数量高达 70 亿的大型模型,证明了用时间提升模型输出内容效果做法可行。

此外,谷歌 DeepMind 最近也公布了类似的论文,他们认为可以为小模型动态分配运算资源,并设置验证器对模型的解答结果进行评分,从而引导模型不断输出正确的答案,从而帮助企业以较少的资源部署足够精度的语言模型。