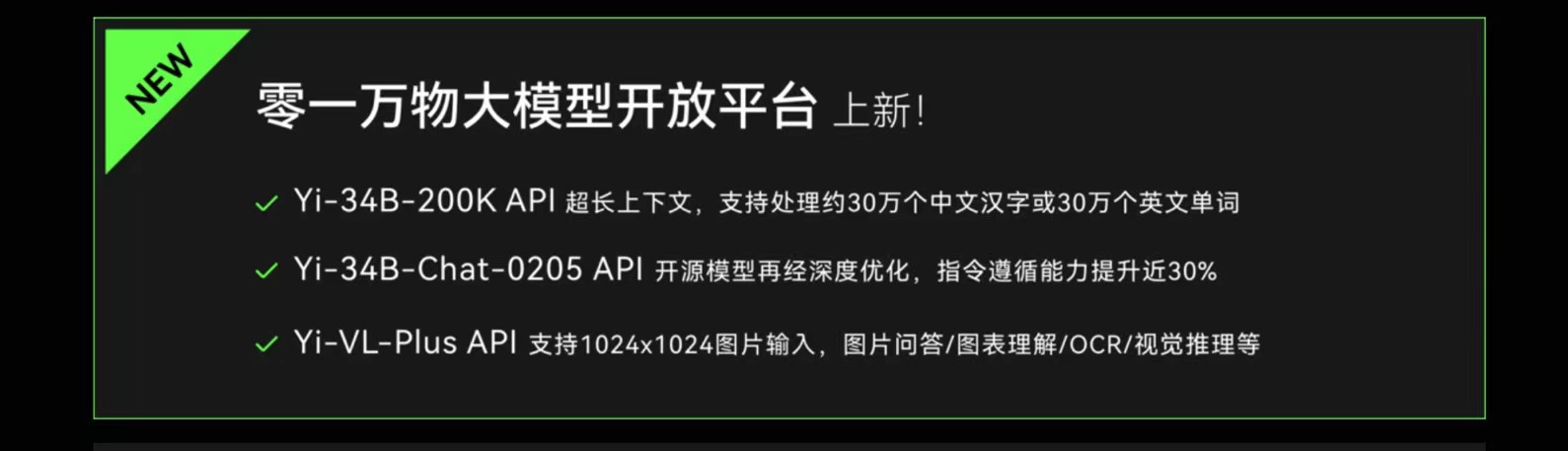

零一万物3月14日发布Yi大模型API开放平台,即日起为开发者提供服务。Yi大模型API与OpenAI API兼容,只需修改少量代码即可平滑迁移。

其中,Yi-34B-Chat-0205支持通用聊天、问答、对话、写作、翻译等功能;Yi-34B-Chat-200K模型支持输入30万汉字,加速大模型应用进入“长文本时代”。该模型适合用于多篇文档内容理解、海量数据分析挖掘和跨领域知识融合等,为各行各业提供了极大的便利。在“大海捞针”测试中,Yi-34B-Chat-200K的性能从89.3%提升至99.8%。

另据介绍,Yi-34B-Chat系列API具备较快的推理速度,这不仅缩短了处理时间,同时也保持了出色的模型效果。此外,优化的API接口显著降低了模型回复的延迟,进一步提升了用户体验的流畅性和响应速度。

零一万物API开发平台还提供多模态模型Yi-VL-Plus,可支持文本、视觉多模态输入,面向实际应用场景大幅增强Charts、Table、Inforgraphics、Screenshot识别能力,支持复杂图表理解、信息提取、问答以及推理。其在Yi-VL基础上进一步提高图片分辨率,模型支持1024*1024分辨率输入,显著提高生产力场景中文字、数字OCR的准确性,同时保持了LLM通用语言、知识、推理、指令跟随等能力。值得一提的是,Yi-VL-Plus模型在一些中文图表理解场景,比GPT-4V准确率更高。

在此前的全球多项权威评测榜单中,零一万物Yi大模型表现优异,性能直追GPT-4。此前,Yi大模型API小范围开放内测,全球已有诸多开发者申请使用,并普遍反馈效果超出预期。目前,Yi大模型API名额限量开放中,新用户赠送60元。

零一万物表示,近期将为开发者提供更多更强模型和AI开发框架,提供更加丰富和灵活的开发工具,以适应多样化的应用场景。例如,推出一系列模型API,覆盖更大的参数量、更强的多模态,更专业的代码/数学推理模型等;突破更长的上下文(目标100万tokens),支持更快的推理速度,显著降低推理成本;基于超长上下文能力,构建向量数据库、RAG、Agent架构在内的全新开发者AI框架等。